演算法 (Algorithm)、AI 運作的核心。圖片:Wharton School, Univ. of Penn.

不是命理師的解說,也不是醫學的檢驗,我們以後的生死,可能是演算出來的,或者說是由「演算法」(Algorithm) 推演的結果。演算法,相當 AI 的心臟,任何用到 AI 的運作,都以演算法為基礎。當第四級以上的自駕車,完全不用人駕駛,一旦遇到不可避免難以脫身的災難,瞬間要怎麼取捨,則取決於演算法,而演算法是我們人設計的。

幾年以前,自駕車的還沒發展到上路,就有人提出「電車難題」(Trolley Problem) 的古老假設,提醒自駕車以後必然遇到的同樣難題。一列失控的有軌電車,急速衝向被綑綁在軌道上的五個人,但距衝撞之前有一個岔道,只要一個人挪動岔道扳手,就可以把車引到岔道,救了直行軌道上的五個人。但岔道上也有一個被綑綁的人,列車一旦進入岔道,這人必死無疑。

電車的難題。如果你手握扳手,是救五個人、還是救一個人?

或者說犧牲一個人、還是犧牲五個人?圖片:ighur.com

依照上圖,大概絕大多數人都會同意犧牲小我,一命換五命,但如果把有軌電車換成自駕汽車,大家想的就未必一致。例如五個是大人、一個人是兒童;五個年紀較輕、一個年長的;五個是壞人、一個人是好人;五個遵守交通規則、一個人則是闖紅燈。除了行人,更可能衝撞的是別的車輛,甚至是自駕車自行撞牆,犧牲車內的乘客......。

說不完的狀況、數不盡的選擇,也超出了演算法的邏輯,沒有人能斷定別人的生死。為此 MIT 媒體實驗室在四年前做了全球性的實驗,稱為「道德機器」(Moral Machine),遊戲般的例舉 13 種假設路況,然後請你回答兩部份問題。第一部分是對自駕車的信心,購買的意願,對失控感到恐慌,道德機器的調查結果是否會用到自駕車,以及簡單的個人資料。

第二部份就進入正題,也就是對價值的偏好,這些偏好或可成為自駕車演算法的參考。包括:社會地位的高低,對交通規則的遵守程度,是否拯救多數人,對乘客的保護,年輕與年老,偏向人類與偏向動物,體型的胖與瘦,性別男與女。最後請你解釋偏好的原因,並提供意見。四年下來,一共收到來自 233 個國家 4,000 萬份回應,成為全球性最大的民調。

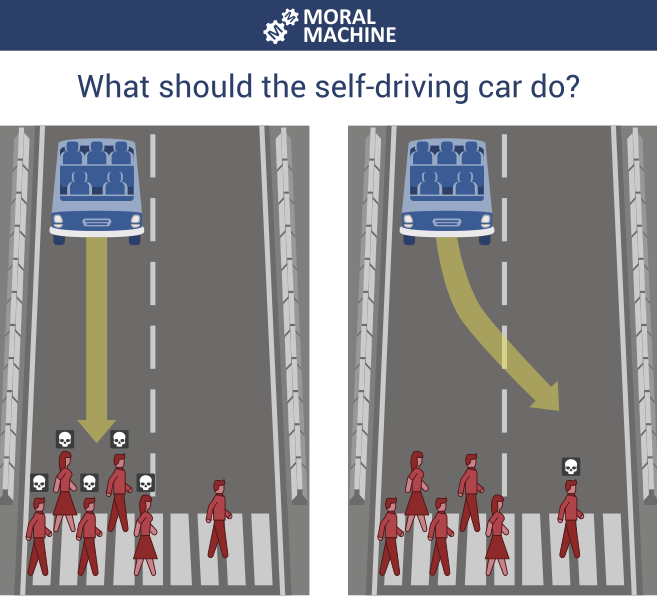

「道德機器」裡一種典型路況。圖片:Moral Machine

上圖就啟動了「拯救多數人」的偏好,如果重視這個偏好,自駕車就會轉到右測車道,犧牲過路的一個人,救了左側過路的五個人,這正是「電車難題」的汽車版,但下圖的情況就複雜得多。自駕車煞車失靈,前有路障,人行道上也有橫跨馬路的行人,只有兩條路可走,自駕車直行自撞路障,車內的乘客可能傷亡,或轉到右側車道,撞擊過路的行人。

複雜的道德選擇。圖片:Moral Machine

在自駕車決定之前,我們先看看所涉及的假設人物。車裡坐著四位乘客,一名男人、一名女運動員、兩名女企業主管。走在路上有一個男孩、一名孕婦、一名嬰兒車裡的嬰兒、一隻貓、與一隻狗。車裡的人是對社會有貢獻的菁英,而過馬路的是婦孺、是寵物,是弱者中的弱者。千鈞一髮,自駕車的演算法必須權衡兩夥人的輕重,做令人不捨的悲傷抉擇。

這當然沒有標準答案,但從參與實驗 4,000 萬人所得到的結果,充分顯示依地區、國家、經濟、文化、倫理背景,有很大的差異。例如以集體性文化為背景的中國、韓國、日本,特別是台灣,對年長者的重視就大於年輕人,研究人員假設是因為這一地區尊敬長者的文化所致。而西歐、美加等國著重個人化的地區,對年輕人的重視就大於長者。

也許正因為個人主義,歐美地區對拯救多數人有正面的反應,偏向集體文化的地區,特別是日本,對拯救多數人有強烈的負面反應。至於車裡乘客優先、還是路上行人優先,集體文化與個人文化兩大陣營的分野就不明顯,日本打頭領先西歐地區,認為行人優先,而加拿大持平,美國略微認為乘客優先,中國則大幅度認為乘客優先。

這個實驗結果當然不會直接用到自駕車的演算法,但可作為 AI 技術的道德考量,用電車難題導引自駕車,也許吸引更多人參與實驗,但專家說或應使用危險分析,而不必決定誰生誰死,這也進入 AI 的倫理討論了。

當自駕車越來越接進正式上路,自駕車交通規則的制定,恐怕也越來越比想像的更複雜。

|